Allgemeine Einführung

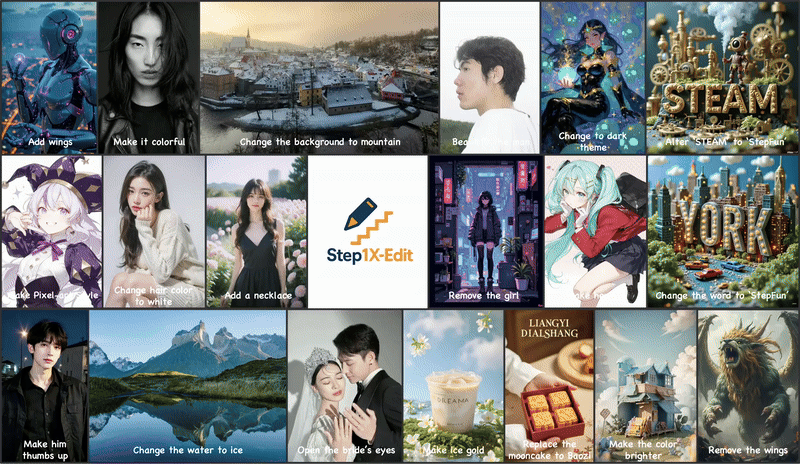

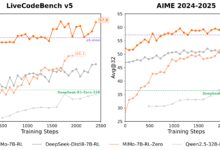

Step1X-Edit ist ein vom Stepfun AI-Team entwickeltes und auf GitHub gehostetes Open-Source-Framework für die Bildbearbeitung, das ein multimodales großes Sprachmodell (Qwen-VL) und einen Diffusionstransformator (DiT) kombiniert, um Nutzern die Möglichkeit zu geben, ein Bild mit einfachen Befehlen in natürlicher Sprache zu bearbeiten, z. B. den Hintergrund zu ändern, ein Objekt zu entfernen oder den Stil zu wechseln. Das Projekt wurde am 25. April 2025 veröffentlicht und kommt in seiner Leistung den Closed-Source-Modellen wie GPT-4o und Zwillinge 2 Flash. step1X-Edit bietet Modellgewichte, Inferenzcode und GEdit-Bench-Benchmarking, um eine breite Palette von Bearbeitungsszenarien zu unterstützen. Die Apache 2.0-Lizenz erlaubt die freie Nutzung und kommerzielle Entwicklung und zieht Entwickler, Designer und Forscher an. Die Gemeinschaft unterstützt aktiv und hat folgende Projekte ins Leben gerufen ComfyUI Plug-ins und FP8 quantisierte Versionen zur Optimierung der Hardwareanforderungen.

Derzeit verfügbar in Schritt AI Kostenlose Erfahrung. Die tatsächlichen Bildbearbeitungsergebnisse unterscheiden sich jedoch leicht von GPT-4o und Gemini 2 Flash.

Funktionsliste

- Unterstützt natürlichsprachliche Befehle für die Bearbeitung von Bildern, z. B. "Hintergrund in Strand ändern" oder "Personen aus dem Foto entfernen".

- Parsing von Bild- und Textbefehlen mit einem multimodalen großen Sprachmodell (Qwen-VL) zur Erzeugung präziser Bearbeitungen.

- Erzeugt qualitativ hochwertige Bilder auf der Grundlage des Diffusionstransformators (DiT), der die ursprünglichen Bilddetails beibehält.

- Bietet GEdit-Bench-Benchmarking zur Bewertung der Bearbeitungsleistung unter echten Benutzerbefehlen.

- Unterstützt quantitative FP8-Modelle, reduziert die Hardware-Anforderungen und passt sich an GPUs mit geringem Speicherplatz an.

- Die Integration mit dem ComfyUI-Plug-in vereinfacht den Arbeitsablauf und verbessert die Benutzerfreundlichkeit.

- Eine Online-Demo ist verfügbar, mit der die Benutzer die Bearbeitungsfunktionen ohne Installation ausprobieren können.

- Open-Source-Modellgewichte und Inferenzcode zur Unterstützung von Sekundärentwicklung und Forschung.

Hilfe verwenden

Einbauverfahren

Um Step1X-Edit zu verwenden, müssen Sie die Umgebung installieren und die Modellgewichte herunterladen. Nachfolgend finden Sie die detaillierten Schritte, geeignet für Linux-Systeme (Ubuntu 20.04 oder höher empfohlen):

- Vorbereiten der Umgebung

Stellen Sie sicher, dass Python 3.10 oder höher auf Ihrem System installiert ist, sowie das CUDA-Toolkit (12.1 empfohlen). Ein Grafikprozessor wird empfohlen (am besten 80 GB RAM, z. B. der NVIDIA H800), aber die quantisierten Versionen von FP8 unterstützen auch weniger RAM (16 GB oder 24 GB).conda create -n step1x python=3.10 conda activate step1x

- Klon-Lager

Laden Sie den Step1X-Edit Projektcode von GitHub herunter:git clone https://github.com/stepfun-ai/Step1X-Edit.git cd Step1X-Edit - Installation von Abhängigkeiten

Installieren Sie PyTorch (2.3.1 oder 2.5.1 empfohlen) und die zugehörigen Bibliotheken:pip install torch==2.3.1 torchvision --index-url https://download.pytorch.org/whl/cu121 pip install -r requirements.txtInstallieren Sie Flash Attention (optional, zur Beschleunigung des Denkens):

pip install flash-attn --no-build-isolationWenn Sie Probleme mit der Installation von Flash Attention haben, können Sie das offizielle Skript verwenden, um eine für Ihr System geeignete vorkompilierte Wheel-Datei zu erstellen:

python scripts/find_flash_attn_wheel.py - Download Modellgewichte

Laden Sie die Modellgewichte und den Variablen Autocoder (VAE) von Hugging Face oder ModelScope herunter:- Schritt1X-Bearbeiten Sie das Modell:

step1x-edit-i1258.safetensors(ungefähr 24,9 GB) - VAE:

vae.safetensors(ungefähr 335MB) - Qwen-VL-Modell:

Qwen/Qwen2.5-VL-7B-Instruct

Automatisierte Downloads mit Python-Skripten:

from huggingface_hub import snapshot_download import os target_dir = "models/step1x" os.makedirs(target_dir, exist_ok=True) # 下载 Step1X-Edit 模型 snapshot_download(repo_id="stepfun-ai/Step1X-Edit", local_dir=target_dir, allow_patterns=["step1x-edit-i1258.safetensors"]) # 下载 VAE snapshot_download(repo_id="stepfun-ai/Step1X-Edit", local_dir=target_dir, allow_patterns=["vae.safetensors"]) # 下载 Qwen-VL qwen_dir = os.path.join(target_dir, "Qwen2.5-VL-7B-Instruct") snapshot_download(repo_id="Qwen/Qwen2.5-VL-7B-Instruct", local_dir=qwen_dir) - Schritt1X-Bearbeiten Sie das Modell:

- logische Schlussfolgerung

Bearbeiten Sie ein Bild mit dem mitgelieferten Argumentationsskript. Bearbeiten Sie zum Beispiel ein Bild und ändern Sie den Hintergrund:python scripts/run_inference.py --image_path assets/demo.png --prompt "将背景改为夜空" --output_path output.pngParameter Beschreibung:

--image_path: Geben Sie den Bildpfad ein.--promptEditierbefehle (z.B. "Himmel in Sonnenuntergang ändern").--output_path: Pfad des Ausgabebildes.--size_levelAuflösung (Standard 512x512, 1024x1024 erfordert mehr Speicher).--seed: Zufällige Samen zur Kontrolle der Konsistenz der Generierung.

Verwendung des ComfyUI-Plug-ins

Step1X-Edit bietet ein ComfyUI-Plug-in für Benutzer, die es in ihre Arbeitsabläufe integrieren möchten.

- Klonen Sie das ComfyUI-Plugin-Repository:

cd path/to/ComfyUI/custom_nodes git clone https://github.com/quank123wip/ComfyUI-Step1X-Edit.git - Setzen Sie die Modellgewichte auf die

ComfyUI/models/Step1x-EditKatalog:step1x-edit-i1258.safetensorsvae.safetensors- Qwen-VL-Modellordner:

Qwen2.5-VL-7B-Instruct

- Starten Sie ComfyUI und laden Sie den Knoten Step1X-Edit.

- Laden Sie in der ComfyUI-Oberfläche ein Bild hoch, geben Sie einen Bearbeitungsbefehl ein (z. B. "Flügel hinzufügen") und führen Sie den Workflow aus, um das Ergebnis zu erzeugen.

Hauptfunktionen

- Editor für natürliche Sprache

Der Benutzer lädt ein Bild hoch und gibt einen Textbefehl ein. Um z.B. den Hintergrund eines Fotos in eine Bergansicht zu ändern, geben Sie "change background to mountain view" ein. Das Modell analysiert den Befehl durch Qwen-VL, extrahiert die Semantik und erzeugt in Verbindung mit DiT ein neues Bild. Es wird empfohlen, die Befehle klar und spezifisch zu formulieren, z. B. "Himmel in blauen Sternenhimmel ändern" ist effektiver als "Himmel verschönern". - Entfernen oder Hinzufügen von Objekten

Befehle wie "Eine Person aus einem Foto entfernen" oder "Einen Baum hinzufügen". Das Modell behält den Rest des Bildes bei und bearbeitet den angegebenen Bereich präzise. Bei komplexen Szenen können mehrere Anpassungen der Befehle das Ergebnis optimieren. - Stilbruch

Die stilisierte Bearbeitung wird unterstützt, z. B. "Bild in Pixel-Art-Stil konvertieren" oder "in Miyazaki-Stil ändern". Das Modell wird diffundiert, um ein stilisiertes Bild zu erzeugen. - Online-Demo

Besuchen Sie den Raum Hugging Face (https://huggingface.co/spaces/stepfun-ai/Step1X-Edit), laden Sie ein Bild hoch, geben Sie Anweisungen ein und erleben Sie es direkt. Jede Generation ist durch die GPU-Zeit begrenzt und kostenlose Nutzer haben zwei Versuche.

caveat

- Hardware-VoraussetzungDie quantisierte FP8-Version kann auf 16 GB Speicher für GPUs wie die 3090 Ti reduziert werden.

- Optimierung der BefehleKomplexe Bearbeitungen erfordern detaillierte Anweisungen, wie z. B. "Ändern Sie den Hintergrund in verschneite Berge, lassen Sie die Zeichen im Vordergrund unverändert".

- Unterstützung der GemeinschaftDas GitHub-Repository hat eine aktive Community, also schauen Sie unter Issues oder Discussions nach, wenn Sie auf Probleme stoßen.

Anwendungsszenario

- Erstellung von Inhalten

Designer verwenden Step1X-Edit, um schnell den Hintergrund zu ändern oder den Stil von Werbematerialien anzupassen. Ändern Sie zum Beispiel den Hintergrund eines Produktfotos in ein Urlaubsmotiv, um die visuelle Attraktivität zu erhöhen. - Persönliche Fotobearbeitung

Mit Hilfe von Online-Demos, die einfach zu bedienen sind und keine professionellen Kenntnisse erfordern, können auch normale Nutzer ihre Fotos verschönern, z. B. indem sie den Hintergrund entfernen oder ein Foto bei Tag in ein Nachtfoto verwandeln. - Optimierung von E-Commerce-Produkten

E-Commerce-Plattformen nutzen Step1X-Edit, um Bilder für die Produktpräsentation in verschiedenen Szenarien zu generieren, z. B. um Kleidung vor einem Strand- oder Stadthintergrund zu platzieren und so Aufnahmekosten zu sparen. - akademische Forschung

Forscher nutzen den GEdit-Bench-Datensatz und die Modellgewichte, um neue Bildbearbeitungsalgorithmen zu entwickeln oder die Leistung von Modellen zu vergleichen.

QA

- Welche Auflösungen werden von Step1X-Edit unterstützt?

Unterstützt die Auflösungen 512x512 und 1024x1024. 512x512 ist schneller und benötigt weniger Speicher, 1024x1024 ist detaillierter und benötigt mehr Speicher. - Wie kann ich meine Bearbeitungsergebnisse optimieren?

Verwenden Sie genaue Anweisungen und vermeiden Sie vage Beschreibungen. Mehrmaliges Ausprobieren verschiedener Formulierungen kann die Ergebnisse verbessern. Zum Beispiel ist "Ändere den Himmel in einen roten Sonnenuntergang" klarer als "Ändere den Himmel". - Unterstützt es chinesische Befehle?

Ja, das Modell unterstützt chinesische Befehle mit Ergebnissen, die mit den englischen vergleichbar sind. Es wird empfohlen, die Anforderungen in prägnanter Sprache zu beschreiben. - FP8 Worin besteht der Unterschied zwischen den quantifizierten Versionen?

Die FP8-Version hat einen geringeren Speicherbedarf (16 GB), kann aber geringfügige Abstriche bei den Details machen. Ideal für Benutzer mit begrenzten Hardware-Ressourcen. - Muss es zum Betrieb vernetzt sein?

Für die lokale Ausführung ist keine Internetverbindung erforderlich. Für Online-Demos ist der Zugriff auf den Hugging Face-Bereich erforderlich.