综合介绍

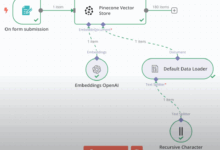

Deep Recall 是一个开源的企业级记忆框架,专为大型语言模型(LLM)设计。它通过高效的上下文检索和整合,提供超个性化的响应能力。框架采用三层架构,包括记忆服务、推理服务和协调器,支持GPU优化推理和向量数据库整合。Deep Recall 适用于云端和本地部署,具备自动化扩展功能,确保高性能和可靠性。它不仅提升模型的上下文感知能力,还能根据用户历史和偏好生成定制化回复,非常适合需要深度个性化交互的场景。

功能列表

- 高效上下文检索:快速从用户历史交互中提取相关信息。

- 个性化响应生成:根据用户偏好和历史数据生成定制化回复。

- GPU优化推理:利用GPU加速推理过程,提升处理速度。

- 向量数据库整合:支持高效存储和查询大规模向量数据。

- 自动化扩展:动态调整资源分配,适应不同负载需求。

- RESTful API支持:提供便捷的记忆管理和检索接口。

- 综合监控与维护:内置监控工具,确保系统稳定运行。

- 安全扫描系统:通过依赖扫描、代码分析等确保代码安全。

使用帮助

安装流程

要使用 Deep Recall,需要在支持 Python 的环境中安装并配置相关依赖。以下是详细的安装步骤:

- 克隆代码仓库

在终端运行以下命令,获取 Deep Recall 源代码:git clone https://github.com/jkanalakis/deep-recall.git cd deep-recall - 创建虚拟环境

为避免依赖冲突,建议创建 Python 虚拟环境:python -m venv venv source venv/bin/activate # Linux/macOS venv\Scripts\activate # Windows - 安装依赖

安装项目所需的运行和开发依赖:pip install -r requirements.txt pip install -r requirements-dev.txt - 配置预提交钩子

为确保代码质量,安装 pre-commit 钩子:pre-commit install - 验证安装

安装完成后,可通过运行测试用例验证环境配置是否正确。参考项目中的CONTRIBUTING.md文件,执行测试命令:pytest

主要功能操作

1. 上下文检索与个性化响应

Deep Recall 的核心功能是基于用户历史交互生成个性化响应。用户通过 RESTful API 调用记忆服务,系统会从向量数据库中检索相关上下文,并结合当前输入生成回复。操作步骤如下:

- API 调用:使用 POST 请求向

/memory/retrieve端点发送用户ID和查询内容。例如:curl -X POST http://localhost:8000/memory/retrieve \ -H "Content-Type: application/json" \ -d '{"user_id": "user123", "query": "推荐一部电影"}' - 响应处理:API 返回包含上下文和生成回复的 JSON 数据,开发者可直接解析并展示给用户。

- 配置个性化:在配置文件

config/memory_config.json中调整检索参数,如上下文窗口大小或相似度阈值。

2. GPU优化推理

Deep Recall 支持 GPU 加速推理,显著提升处理速度。用户需确保系统安装了 CUDA 和相关驱动。配置步骤:

- 安装 GPU 依赖:在安装过程中,确保

requirements.txt中的 GPU 相关库(如 PyTorch)已正确安装。 - 启动推理服务:在项目根目录运行:

python -m deep_recall.inference_service --gpu - 验证 GPU 使用:通过日志确认推理服务正在利用 GPU 资源。

3. 向量数据库整合

Deep Recall 使用向量数据库存储用户交互数据,支持高效查询。操作流程:

- 初始化数据库:运行初始化脚本,创建向量索引:

python scripts/init_vector_db.py - 数据导入:通过 API 或脚本将用户历史数据导入数据库。示例 API 调用:

curl -X POST http://localhost:8000/memory/store \ -H "Content-Type: application/json" \ -d '{"user_id": "user123", "data": "用户喜欢科幻电影"}' - 查询数据:使用检索 API 按需查询存储的向量数据。

4. 自动化扩展

Deep Recall 支持动态资源分配,适合高负载场景。用户可通过配置文件 config/scaling_config.json 设置扩展策略,如最大实例数或负载阈值。启动协调器服务:

python -m deep_recall.orchestrator

协调器会根据负载自动调整推理服务实例数量。

特色功能操作

安全扫描系统

Deep Recall 内置了全面的安全扫描工具,确保代码质量。操作方法:

- 运行依赖扫描:检查 Python 依赖中的已知漏洞:

safety check - 代码安全分析:使用 Bandit 扫描代码中的安全问题:

bandit -r deep_recall - 查看报告:扫描结果以 JSON 和 Markdown 格式保存在

reports/目录,供用户审查。

API 客户端示例

Deep Recall 提供 Python 和 JavaScript 客户端库,简化 API 集成。示例 Python 代码:

from deep_recall_client import DeepRecallClient

client = DeepRecallClient("http://localhost:8000")

response = client.retrieve_memory(user_id="user123", query="推荐一部电影")

print(response["reply"])

用户还可参考项目中的 React 示例前端,快速构建交互界面。

注意事项

- 确保网络连接稳定,API 调用可能因网络问题失败。

- 定期备份向量数据库,参考

docs/backup.md配置自动备份。 - 检查

config/security_config.json,自定义安全扫描规则。

应用场景

- 客户服务机器人

Deep Recall 可为客服机器人提供记忆功能,记录用户历史问题和偏好,生成更贴合用户需求的回复。例如,在电商平台,机器人能根据用户过往购买记录推荐商品。 - 个性化教育平台

在在线教育中,Deep Recall 可存储学生的学习进度和兴趣,生成定制化学习建议。例如,为学生推荐适合其水平的练习题。 - 智能助手开发

开发者可利用 Deep Recall 构建智能助手,记录用户习惯,提供上下文相关的建议。例如,助手可根据用户日程提醒会议或任务。 - 内容推荐系统

Deep Recall 适合构建内容推荐引擎,通过分析用户浏览历史,推荐相关文章、视频或产品。例如,新闻平台可根据用户阅读偏好推送个性化资讯。 - 企业知识管理

企业可使用 Deep Recall 构建内部知识库,存储员工交互数据,快速检索历史信息。例如,技术支持团队可通过系统查找过往解决方案。

QA

- Deep Recall 支持哪些大模型?

Deep Recall 兼容多种开源大模型,如 LLaMA、Mistral 和 BERT。用户可参考官方文档docs/model_support.md查看完整支持列表。 - 如何确保数据隐私?

Deep Recall 支持本地部署,数据存储在用户控制的服务器上。用户可通过加密卷或配置防火墙进一步保护数据隐私。 - 是否需要 GPU 运行?

GPU 可加速推理,但不是必需。CPU 环境也能运行 Deep Recall,只是处理速度稍慢。建议高负载场景使用 GPU。 - 如何处理 API 调用失败?

检查网络连接和 API 端点配置。若问题持续,查看日志文件logs/service.log或联系官方支持邮箱。 - 是否支持多语言数据?

是的,Deep Recall 的向量数据库支持多语言文本存储和检索,适合国际化应用场景。